Lo más probable es que cuando leáis este artículo sobre ChatGPT hayan surgido otros muchos sistemas más modernos o más fiables y penséis que lo relatado aquí es algo del pasado pero me parece que quizás sea aplicable en general a todos los sistemas de Inteligencia Artificial.

En una de mis clases de conversación les había dado a los estudiantes diferentes cuadros más o menos conocidos donde aparecían varios personajes que parecían estar hablando. Los estudiantes tenían que imaginar un diálogo y el objetivo era usar el vocabulario, estructuras y expresiones que hemos aprendido a lo largo del curso. Los resultados estaban siendo divertidos y yo estaba encantada porque estábamos usando de manera práctica los contenidos que habíamos estudiado. A última hora los ánimos estaban más bajos y ante la falta de inspiración una estudiante decidió pedirle ayuda a ChatGPT. Había que crear un diálogo para un cuadro de ¨La adoración de los Reyes Magos¨. La primera reacción fue descorazonadora: la herramienta no podía crear un diálogo para un cuadro porque el cuadro era una imagen, no una situación donde hubiera comunicación. No desesperamos, le dimos algunas instrucciones más concretas y ahora sí, el sistema nos pudo proporcionar una conversación entre varios personajes que nosotros previamente habíamos especificado. Nos parecía que estaba bien pero que le faltaba una chispa de humor así que le pedimos al sistema que lo incluyera. No era el chiste más divertido del mundo, pero al menos sí nos sacó una sonrisa. El resultado fue un diálogo comparable al que los otros estudiantes habían creado así que nos pareció una herramienta práctica y que se podía usar en caso de que la inspiración nos fallara. No está mal. Lo que también nos quedó claro es que había que ayudar al sistema si el resultado no nos convencía o si queríamos algo más vistoso.

Otra de las estudiantes, sorprendida ante el resultado, decidió ponerlo en práctica pidiéndole al sistema que escribiera una reflexión con este título ¨¿Qué es la felicidad para ti?¨usando un español de nivel C1. Primer detalle importante: al sistema hay que darle unas instrucciones muy claras y detalladas. En cuestión de segundos el sistema produjo un texto muy correcto y del nivel que le habíamos pedido, muy bien estructurado, con una introducción atractiva y con una conclusión lógica. Si tuviera que puntuarlo le daría una nota buena pero no la más alta porque le faltaba algo para mí fundamental en una reflexión de estas características: la parte subjetiva con ejemplos basados en la vida de la persona que escribe. Para ChatGPT es facilísimo buscar párrafos más o menos profundos sobre este o cualquier tema porque esa es justamente su función. Sin embargo, si el enfoque está en la experiencia personal entonces falla. No le puedes pedir a un robot que te explique qué es la felicidad. Como otro de los estudiantes añadió, la herramienta nos proporciona una plantilla, un esquema que nos puede ayudar mucho si no tenemos inspiración y que podemos después rellenar con nuestras expectativas en la vida o nuestras ideas concretas respecto a la felicidad. También la lectura de algunos párrafos nos puede inspirar a la hora de empezar a escribir porque podemos reaccionar a lo que aparece ya sea porque estamos de acuerdo o porque no. De nuevo, nuestra conclusión fue que el sistema nos proporcionaba ayuda pero que el grueso del trabajo era para el estudiante.

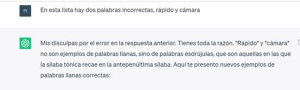

Intrigada después de experimentar en clase decidí hacerme una cuenta en ChatGPT para poder lanzarle yo mis preguntas. La primera que se me ocurrió fue pedirle ejemplos de palabras agudas, llanas y esdrújulas. No todas revueltas, claro, sino cada grupo por separado. El resultado aquí sí fue desalentador. El sistema produjo diez resultados en cada ocasión y como mínimo en cada caso había cuatro palabras incorrectas. Me sentí un poco decepcionada. El sistema me ayudaba con su rapidez pero no con la corrección. Yo lo podía corregir pero ¿qué habría pasado si quien hiciera la pregunta no tuviera el conocimiento suficiente para distinguir las palabras correctas de las que no lo son? Habría metido la pata. Le dije al sistema que había cometido errores y para mi sorpresa me pidió disculpas y me propuso otras que sí eran correctas.

Educado, desde luego, es este sistema.

Posteriormente volví a usarlo para pedirle ejemplos de actividades comunicativas o para que me sugiriera temas para la clase de conversación en un nivel avanzado. La variedad y cantidad que me propuso me dejó boquiabierta. Sin embargo, al leerlo más en detalle llegué a la misma conclusión que en la aventura anterior: no todo es correcto.

¿Cuál es mi opinión respecto a ChatGPT o cualquiera de las nuevas herramientas que están apareciendo como setas? Podría resumirla en tres conclusiones y un consejo:

La primera es que nuestras instrucciones tienen que ser claras y precisas si queremos la respuesta más ajustada posible.

La segunda es que si no sabes nada del tema sobre el que preguntas corres el riesgo de que el sistema te proponga información falsa y ¿cómo distinguir lo que es correcto de lo que no lo es?

La tercera es que como fuente de inspiración y creatividad es inagotable. Por supuesto que hay que seleccionar pero la base está ahí.

Mi consejo es que usemos esta herramienta si nos va a servir para facilitarnos una tarea o para ahorrar tiempo, para inspirarnos cuando las neuronas ya no den más de sí o incluso como base para crear algo más complejo pero seamos conscientes de que perfecta no es. Y muy importante, siempre va a faltar la parte más subjetiva y personal.

Ahora que llego al final de esta reflexión, me doy cuenta de que podría haber ahorrado tiempo si le hubiera pedido a ChatGPT que escribiera este artículo. Como no me voy a quedar con las ganas y soy curiosa lo hago. Os copio solo la conclusión. ¿Qué os parece?

Pili Molina